Tác giả: Sebastian Bustillo

Ngày phát hành: 21 JAN 2026

Chuyên mục: Amazon Bedrock, Amazon Machine Learning, Artificial Intelligence, Strands Agents, Technical How-to

Các giải pháp đa tác nhân, trong đó các mạng lưới tác nhân cộng tác, phối hợp và suy luận cùng nhau, đang thay đổi cách chúng ta tiếp cận các thách thức trong thế giới thực. Các doanh nghiệp quản lý môi trường với nhiều nguồn dữ liệu, mục tiêu thay đổi và các ràng buộc khác nhau. Đây là nơi kiến trúc đa tác nhân phát huy tác dụng. Bằng cách trao quyền cho nhiều tác nhân, mỗi tác nhân có các công cụ, bộ nhớ hoặc góc nhìn chuyên biệt để tương tác và suy luận như một tập thể, các tổ chức mở khóa những khả năng mới mạnh mẽ:

- Khả năng mở rộng – Các framework đa tác nhân xử lý các tác vụ có độ phức tạp ngày càng tăng, phân phối khối lượng công việc một cách thông minh và thích ứng để mở rộng quy mô theo thời gian thực.

- Khả năng phục hồi – Khi các tác nhân làm việc cùng nhau, lỗi ở một tác nhân có thể được bù đắp hoặc giảm thiểu bởi các tác nhân khác, tạo ra các hệ thống mạnh mẽ, chịu lỗi.

- Chuyên môn hóa – Các tác nhân riêng lẻ xuất sắc trong các lĩnh vực cụ thể (như tài chính, chuyển đổi dữ liệu và hỗ trợ người dùng) nhưng vẫn có thể hợp tác liền mạch để giải quyết các vấn đề đa ngành.

- Giải quyết vấn đề động – Các hệ thống đa tác nhân có thể nhanh chóng cấu hình lại, xoay trục và phản ứng với sự thay đổi, điều này rất cần thiết trong môi trường kinh doanh, bảo mật và vận hành biến động.

Các bản phát hành gần đây trong các framework AI tác nhân, chẳng hạn như Strands Agents, giúp các nhà phát triển dễ dàng tham gia vào việc tạo và triển khai các giải pháp đa tác nhân dựa trên mô hình. Bạn có thể định nghĩa các prompt và tích hợp các bộ công cụ, cho phép các mô hình ngôn ngữ mạnh mẽ suy luận, lập kế hoạch và gọi công cụ một cách tự động thay vì dựa vào các quy trình thủ công, dễ hỏng.

Trong môi trường sản xuất, các dịch vụ như Amazon Bedrock AgentCore hỗ trợ triển khai an toàn, có khả năng mở rộng với các tính năng như bộ nhớ bền vững, tích hợp danh tính và khả năng quan sát cấp doanh nghiệp. Sự chuyển đổi sang các giải pháp AI đa tác nhân, cộng tác này đang cách mạng hóa kiến trúc phần mềm bằng cách làm cho chúng tự chủ hơn, linh hoạt hơn và dễ thích nghi hơn. Từ việc khắc phục sự cố theo thời gian thực trong cơ sở hạ tầng đám mây đến tự động hóa đa nhóm trong dịch vụ tài chính và các trợ lý dựa trên trò chuyện điều phối các quy trình kinh doanh phức tạp nhiều bước, các tổ chức áp dụng các giải pháp đa tác nhân đang định vị mình để đạt được sự nhanh nhẹn và đổi mới lớn hơn. Giờ đây, với các framework mở như Strands, bất kỳ ai cũng có thể bắt đầu xây dựng các hệ thống thông minh cùng nhau suy nghĩ, tương tác và phát triển.

Trong bài đăng này, chúng ta sẽ khám phá cách xây dựng một quy trình xử lý video đa tác nhân bằng cách sử dụng Strands Agents, các mô hình Llama 4 của Meta và Amazon Bedrock để tự động phân tích và hiểu nội dung video thông qua các tác nhân AI chuyên biệt làm việc phối hợp. Để giới thiệu giải pháp, chúng ta sẽ sử dụng Amazon SageMaker AI để hướng dẫn bạn qua mã.

Llama 4 của Meta: Mở khóa giá trị của cửa sổ ngữ cảnh 1M+

Llama 4 là dòng mô hình ngôn ngữ lớn (LLM) mới nhất của Meta nổi bật với khả năng cửa sổ ngữ cảnh và trí tuệ đa phương thức. Cả hai mô hình đều sử dụng kiến trúc mixture-of-experts (MoE) để đạt hiệu quả, được thiết kế cho đầu vào đa phương thức và được tối ưu hóa để cung cấp năng lượng cho các hệ thống tác nhân và quy trình làm việc phức tạp. Biến thể hàng đầu, Llama 4 Scout của Meta, hỗ trợ cửa sổ ngữ cảnh 10 triệu token—một bước đột phá trong ngành—cho phép mô hình xử lý và suy luận trên lượng lớn dữ liệu trong một prompt duy nhất.

Điều này hỗ trợ các ứng dụng như tóm tắt toàn bộ thư viện sách, phân tích các cơ sở mã khổng lồ, tiến hành nghiên cứu toàn diện trên hàng nghìn tài liệu và duy trì ngữ cảnh hội thoại sâu, bền vững trong các tương tác dài. Biến thể Llama 4 Maverick cũng cung cấp cửa sổ 1 triệu token, làm cho nó phù hợp cho các tác vụ ngôn ngữ, thị giác và đa tài liệu đòi hỏi khắt khe. Các cửa sổ ngữ cảnh cực dài này mở ra những khả năng mới cho việc tóm tắt nâng cao, duy trì bộ nhớ và các quy trình làm việc phức tạp, nhiều bước, định vị Llama 4 của Meta như một giải pháp linh hoạt cho cả nghiên cứu và các ứng dụng AI cấp doanh nghiệp.

| Tên mô hình | Cửa sổ ngữ cảnh | Khả năng và trường hợp sử dụng chính |

|---|---|---|

| Llama 4 Scout của Meta | 10M token (lên đến 3.5M bằng Amazon Bedrock) | Xử lý tài liệu cực dài, nhập toàn bộ sách hoặc cơ sở mã, tóm tắt quy mô lớn, bộ nhớ đối thoại mở rộng, nghiên cứu nâng cao |

| Llama 4 Maverick của Meta | 1M token | Các tác vụ đa phương thức ngữ cảnh lớn, hiểu tài liệu và hình ảnh nâng cao, phân tích mã, Q&A toàn diện, tóm tắt mạnh mẽ |

Tổng quan giải pháp

Bài đăng này trình bày cách xây dựng một quy trình xử lý video đa tác nhân bằng cách sử dụng Strands Agents SDK, Llama 4 của Meta với khả năng đa phương thức và cửa sổ ngữ cảnh của nó, cùng với cơ sở hạ tầng có khả năng mở rộng của Amazon Bedrock. Mặc dù bài đăng này tập trung chủ yếu vào việc xây dựng các tác nhân chuyên biệt để tạo giải pháp phân tích video này, nhưng các phương pháp tạo quy trình làm việc đa tác nhân có thể được sử dụng để xây dựng giải pháp tự động, thích ứng của riêng bạn ở cấp doanh nghiệp.

Để mở rộng quy mô, cách tiếp cận này mở rộng một cách tự nhiên để xử lý khối lượng công việc lớn hơn và đa dạng hơn, chẳng hạn như xử lý luồng video từ hàng triệu thiết bị được kết nối trong các thành phố thông minh, tự động hóa công nghiệp để bảo trì dự đoán thông qua phân tích dữ liệu video và cảm biến liên tục, hệ thống giám sát thời gian thực trên nhiều địa điểm hoặc các công ty truyền thông quản lý thư viện lớn để lập chỉ mục và truy xuất nội dung. Sử dụng tích hợp sẵn có của Strands Agents với các dịch vụ Amazon Web Services (AWS) và cơ sở hạ tầng AI được quản lý của Amazon Bedrock có nghĩa là các quy trình làm việc đa tác nhân của bạn có thể mở rộng linh hoạt, phân phối tác vụ hiệu quả và duy trì tính sẵn sàng cao cũng như khả năng chịu lỗi. Bạn có thể xây dựng các quy trình làm việc phức tạp, nhiều bước trên các nguồn dữ liệu và trường hợp sử dụng không đồng nhất—từ phân tích video trực tiếp đến trải nghiệm truyền thông được cá nhân hóa—trong khi vẫn duy trì sự linh hoạt để thích ứng và mở rộng khi nhu cầu kinh doanh phát triển.

Giới thiệu về quy trình làm việc tác nhân bằng Strands Agents

Bài đăng này trình bày một giải pháp xử lý video triển khai quy trình làm việc tác nhân sử dụng sáu tác nhân chuyên biệt. Mỗi tác nhân thực hiện một vai trò cụ thể, chuyển đầu ra của nó cho tác nhân tiếp theo để hoàn thành các tác vụ nhiều bước trong quy trình. Điều này được thực hiện thông qua cùng một phân tích như kiến trúc nghiên cứu sâu, trong đó có một tác nhân điều phối điều phối quá trình các tác nhân khác làm việc cùng nhau. Khái niệm này trong Strands Agents được gọi là Agents as Tools.

Mô hình kiến trúc này trong các hệ thống AI cho phép các tác nhân AI chuyên biệt được đóng gói dưới dạng các hàm có thể gọi (công cụ) có thể được sử dụng bởi các tác nhân khác. Quy trình làm việc tác nhân này có các tác nhân chuyên biệt sau:

Llama4_coordinator_agent– Có quyền truy cập vào các tác nhân khác và khởi động quá trình từ tác nhân trích xuất khung hình đến tạo tóm tắt.s3_frame_extraction_agent– Sử dụng thư viện OpenCV để trích xuất các khung hình có ý nghĩa từ video, xử lý sự phức tạp của các hoạt động tệp video.s3_visual_analysis_agent– Có các công cụ cần thiết để xử lý các khung hình bằng cách phân tích từng hình ảnh và lưu trữ nó dưới dạng tệp JSON vào bucket Amazon Simple Storage Service (Amazon S3) được cung cấp.retrieve_json_agent– Truy xuất phân tích trên các khung hình dưới dạng tệp JSON.c_temporal_analysis_agent– Tác nhân AI chuyên về các chuỗi thời gian trong các khung hình video bằng cách phân tích hình ảnh theo thứ tự thời gian.summary_generation_agent– Chuyên tạo tóm tắt phân tích thời gian của các hình ảnh.

Mô-đun hóa giải pháp phân tích video với Agents as Tools

Quá trình bắt đầu với tác nhân điều phối, được triển khai bằng Llama 4 của Meta, điều phối giao tiếp và ủy quyền tác vụ giữa các tác nhân chuyên biệt. Tác nhân trung tâm này khởi tạo và giám sát từng bước của quy trình xử lý video. Sử dụng mô hình Agents as Tools trong Strands Agents, mỗi tác nhân chuyên biệt được đóng gói dưới dạng một hàm có thể gọi (công cụ), cho phép giao tiếp giữa các tác nhân liền mạch và điều phối mô-đun. Mô hình ủy quyền phân cấp này cho phép tác nhân điều phối gọi động các tác nhân chuyên biệt theo miền, phản ánh cách các nhóm người cộng tác hoạt động.

- Khả năng tùy chỉnh – Prompt hệ thống của mỗi tác nhân có thể được điều chỉnh độc lập để đạt hiệu suất tối ưu trong tác vụ chuyên biệt của nó.

- Phân tách mối quan tâm – Các tác nhân tập trung vào những gì họ làm tốt nhất, làm cho hệ thống dễ phát triển và bảo trì hơn.

- Tính linh hoạt của quy trình làm việc – Tác nhân điều phối có thể điều phối các thành phần theo các trình tự khác nhau cho các trường hợp sử dụng khác nhau.

- Khả năng mở rộng – Các thành phần có thể được tối ưu hóa riêng lẻ dựa trên các yêu cầu hiệu suất cụ thể của chúng.

- Khả năng mở rộng – Các khả năng mới có thể được thêm vào bằng cách giới thiệu các tác nhân chuyên biệt mới mà không làm gián đoạn các tác nhân hiện có.

Bằng cách biến các tác nhân thành công cụ, chúng ta tạo ra các khối xây dựng có thể được kết hợp để giải quyết các tác vụ hiểu video phức tạp, chứng minh cách bạn có thể sử dụng Strands Agents để hỗ trợ các hệ thống đa tác nhân với suy luận dựa trên LLM chuyên biệt. Hãy cùng xem xét coordinator_agent:

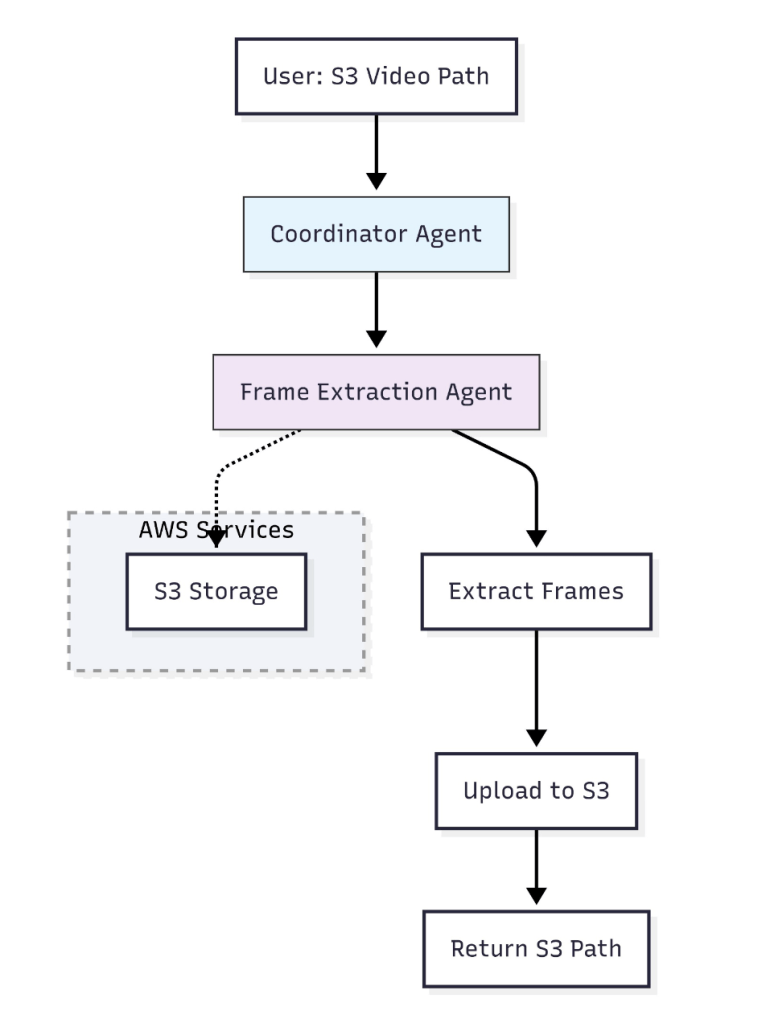

def new_llama4_coordinator_agent() -> Agent: """ Factory constructor: creates a NEW agent instance with a fresh conversation history. Use this per video request for clean isolation. """ return Agent( system_prompt="""You are a video processing coordinator. Your job is to process videos step by step.##When asked to process a video:1. Extract frames from S3 video using run_frame_extraction2. Use the frame location from step 1 to run_visual_analysis3. WAIT for visual analysis to complete sending the json to s34. Use the retrieve_json agent to extract the json from step 35. Use the text result of retrieve_json_from_s3 by passing it to run_temporal_reasoning6. Pass the result from temporal reasoning to run_summary_generation7. Upload analysis generated in run_summary_generation and return s3 location##IMPORTANT:- Call ONE tool at a time and wait for the result- Use the EXACT result from the previous step as input- Do NOT call multiple tools simultaneously- Do NOT return raw JSON or function call syntax""", model=bedrock_model, tools=[ run_frame_extraction, run_visual_analysis, run_temporal_reasoning, run_summary_generation, upload_analysis_results, retrieve_json_from_s3, ], )Việc gọi coordinator_agent kích hoạt quy trình làm việc tác nhân để gọi s3_frame_extraction_agent. Tác nhân chuyên biệt này có các công cụ cần thiết để trích xuất các khung hình chính từ video đầu vào bằng OpenCV, tải các khung hình lên Amazon S3 và xác định đường dẫn thư mục để chuyển cho tác nhân run_visual_analysis. Sơ đồ sau đây cho thấy luồng này.

Sơ đồ 1: Luồng xử lý video đa tác nhân

Sau khi các khung hình được lưu trữ trong Amazon S3, visual_analysis_agent sẽ có quyền truy cập vào các công cụ liệt kê các khung hình từ thư mục S3, sử dụng Llama của Meta trong Amazon Bedrock để xử lý hình ảnh và tải phân tích dưới dạng tệp JSON lên Amazon S3.

Đoạn mã dưới đây sẽ hướng dẫn bạn qua các phần chính khác nhau của các tác nhân. Ví dụ sau đây cho thấy visual_analysis_agent:

@tooldef upload_local_json_to_s3(s3_video_path: str, local_filename: str = "visual_analysis_results.json") -> str: """Upload local JSON file to S3 bucket in video folder""" try: s3_parts = [part for part in s3_video_path.replace('s3://', '').split('/') if part] bucket = s3_parts[0] video_folder = s3_parts[-1] if '_' in video_folder: base_video_name = video_folder.split('_')[0] else: base_video_name = video_folder random_num = randint(1000, 9999) s3_key = f"videos/{base_video_name}/{random_num}_{local_filename}" s3_client = boto3.client('s3') s3_client.upload_file(local_filename, bucket, s3_key) return f"s3://{bucket}/{s3_key}" except Exception as e: return f"Error uploading file: {str(e)}"s_visual_analysis_agent = Agent( system_prompt="""You are an image analysis agent that processes frames from S3 buckets.Your workflow:1. Use the available tools to analyze images2. Use the video path folder to place the analysis resultsIMPORTANT:- Do NOT generate, write, or return any code- Focus on describing what you see in the images- Images are automatically resized if too large- Put numbered labels in front of each image description (e.g., "1. ", "2. ", etc.)- Always save analysis results locally first, then upload to S3Return Format:The uri from the upload_local_json_to_s3 tool""", model=bedrock_model, callback_handler=None, tools=[list_s3_frames, analyze_image, analyze_all_frames, analyze_frames_batch, upload_local_json_to_s3],)Sau khi tải JSON lên Amazon S3, có một tác nhân chuyên biệt truy xuất tệp JSON từ Amazon S3 và phân tích văn bản:

@tooldef process_s3_analysis_json(s3_uri: str) -> str: """Retrieve JSON from S3 and extract only the analysis text""" try: # Parse S3 URI and download JSON s3_parts = s3_uri.replace('s3://', '').split('/', 1) bucket = s3_parts[0] key = s3_parts[1] s3_client = boto3.client('s3') response = s3_client.get_object(Bucket=bucket, Key=key) json_content = response['Body'].read().decode('utf-8') # Parse and extract text data = json.loads(json_content) # Handle both formats if 'analyses' in data: analyses = data['analyses'] elif 'sessions' in data: analyses = [session['data'] for session in data['sessions'] if 'data' in session] else: return "Error: No 'analyses' or 'sessions' field found" # Extract text only text_only = [] for analysis in analyses: if 'analysis' in analysis: text = analysis['analysis'] if not text.startswith("Failed:"): text_only.append(text) # Clean up local file local_file = "visual_analysis_results.json" if os.path.exists(local_file): os.remove(local_file) return "\n".join(text_only) except Exception as e: return f"Error processing {s3_uri}: {str(e)}"bedrock_model = BedrockModel( model_id='us.meta.llama4-maverick-17b-instruct-v1:0', region_name=region, streaming=False, temperature=0) retrieve_json_agent = Agent(system_prompt="Call process_s3_analysis_json with the S3 URI. Your response must be the exact text output from the tool, nothing else.", model=bedrock_model, callback_handler=None, tools=[process_s3_analysis_json],)Đầu ra này sau đó sẽ được đưa vào tác nhân temporal_analysis_agent để có được nhận thức về thời gian của các chuỗi trong các khung hình video và cung cấp mô tả chi tiết về nội dung hình ảnh.

Sau khi đầu ra phân tích thời gian đã được tạo, tác nhân summary_generation_agent sẽ được khởi động để cung cấp bản tóm tắt cuối cùng.

Các bước chuẩn bị và thiết lập

Để chạy giải pháp trên notebook hoặc Gradio UI, bạn cần những điều sau:

- Một tài khoản AWS có quyền truy cập vào Amazon Bedrock.

Để sao chép dự án,

git clone https://github.com/aws-samples/Meta-Llama-on-AWS.gitcd agents/strands/Bedrock/multi-agent-video-processing/- Trong terminal của bạn, cài đặt các dependency chính xác:

pip install -r requirements.txtTriển khai ứng dụng xử lý video trên Gradio

Để triển khai ứng dụng xử lý video trên Gradio, hãy làm theo các hướng dẫn khởi chạy ứng dụng sau:

- Để khởi chạy terminal Python, hãy mở giao diện dòng lệnh Python3 của bạn.

- Để cài đặt các dependency, thực hiện các lệnh

pip installcho các thư viện cần thiết (tham khảo phần cài đặt thư viện ở trên). - Để thực thi ứng dụng, chạy lệnh

python3 gradio_app.py. - Để truy cập giao diện, chọn liên kết được lưu trữ được tạo hiển thị trong terminal.

- Để bắt đầu xử lý video, tải tệp video của bạn lên thông qua giao diện và sau đó chọn Run.

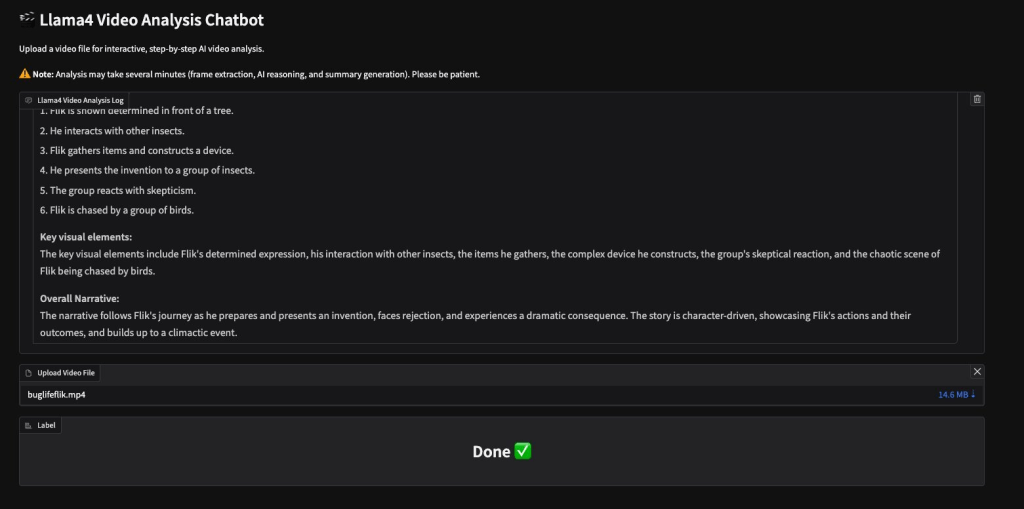

Trợ lý phân tích video Llama của Meta cung cấp đầu ra sau cho video buglifeflik.mp4 được cung cấp trong kho lưu trữ GitHub:

Llama Video Analysis LogFlik is shown determined in front of a tree.He interacts with other insects.Flik gathers items and constructs a device.He presents the invention to a group of insects.The group reacts withskepticism.Flik is chased by a group of birds. Key visual elements:The key visual elements include Flik’s determined expression, his interaction with other insects, the items he gathers, the complex device he constructs, the group’s skeptical reaction, and the chaotic scene of Flik being chased by birds.Overall Narrative:The narrative follows Flik’s journey as he prepares and presents an invention, faces rejection, and experiences a dramatic consequence. The story is character-driven, showcasing Flik’s actions and their outcomes, and builds up to a climactic event.Ảnh chụp màn hình sau đây cho thấy Gradio UI với đầu ra này.

Hình 2: Giao diện người dùng Gradio với kết quả phân tích video Llama 4

Chạy trong Jupyter Notebook

Sau khi các thư viện cần thiết được nhập, bạn cần tải video của mình lên bucket S3 theo cách thủ công:

def upload_to_sagemaker_bucket(local_video_path, base_folder="videos/"): sagemaker = boto3.client('sagemaker') s3 = boto3.client('s3') # Get default SageMaker bucket account_id = boto3.client('sts').get_caller_identity()['Account'] region = boto3.Session().region_name bucket_name = f"sagemaker-{region}-{account_id}" # Get filename and create subfolder name filename = os.path.basename(local_video_path) filename_without_ext = os.path.splitext(filename)[0] # Create the full S3 path: videos/filename_without_ext/filename s3_key = os.path.join(base_folder, filename_without_ext, filename) # Upload file s3.upload_file(local_video_path, bucket_name, s3_key) s3_uri = f"s3://{bucket_name}/{s3_key}" print(f"Uploaded to {s3_uri}") s3_folder_path = os.path.join(base_folder, filename_without_ext) s3_folder_uri = f"s3://{bucket_name}/{s3_folder_path}" return s3_folder_uri# Example usage: Provide your local video path heres3_video_uri = upload_to_sagemaker_bucket(local_video_path)Sau khi video được tải lên, bạn có thể bắt đầu quy trình làm việc tác nhân bằng cách khởi tạo một tác nhân mới với lịch sử hội thoại mới:

# Start the workflowagent = new_llama4_coordinator_agent()video_instruction = f"Process a video from {s3_video_uri}. Use tools in this order: run_frame_extraction, run_visual_analysis, retrieve_json_from_s3, run temporal_reasoning, run_summary_generation_ upload_analysis_results"response = agent(video_instruction)print(response)Tool #1: run_frame_extractionTool #2: run_visual_analysisTool #3: retrieve_json_from_s3Tool #4: run_temporal_reasoningTool #5: run_summary_generationTool #6: run_summary_generation**What happens in the video:**The video follows Flik as he navigates through a series of events, starting from being cautious in a natural setting, seeking help or communicating with other insects, participating in a crucial discussion or planning, and finally taking action with the group.**Chronological Sequence of Events:**The sequence begins with Flik being cautious near a tree, followed by him approaching a group of insects, then being part of a significant gathering or discussion, and concludes with Flik and the insects taking action together.**Sequence of events:**1. Flik is initially seen being cautious in a natural environment.2. He then approaches a group of insects, likely to communicate or seek help.3. A gathering of insects is shown with Flik at the center, indicating a crucial discussion or planning.4. The final scene shows Flik and the insects in action, possibly executing a plan or facing a challenge.**Key visual elements:**The key visual elements include Flik's cautious initial stance, his interaction with other insects, the gathering or discussion, and the final action scene, highlighting the progression from solitude to collective action.**Overall Narrative:**The narrative follows Flik's journey from caution and seeking help to participating in a crucial discussion and finally to taking action with a group of insects, suggesting a story arc that involves progression, planning, and collective action.Tool #7: upload_analysis_resultsThe video processing is complete. The final analysis results are saved to s3://sagemaker-us-west-2-333633606362/videos/buglifeflik/analysis_results_20250818_190012.json.The video processing is complete. The final analysis results are saved to s3://sagemaker-us-west-2-333633606362/videos/buglifeflik/analysis_results_20250818_190012.json.Dọn dẹp

Để tránh phát sinh các chi phí không cần thiết trong tương lai, hãy dọn dẹp các tài nguyên bạn đã tạo như một phần của giải pháp này:

Để xóa các tệp Amazon S3:

- Mở AWS Management Console.

- Điều hướng đến Amazon S3.

- Tìm và chọn bucket Amazon SageMaker của bạn.

- Chọn các tệp video bạn đã tải lên.

- Chọn Delete và xác nhận.

Để dừng và xóa notebook SageMaker:

- Truy cập Amazon SageMaker AI trong AWS Management Console.

- Chọn Notebook instances.

- Chọn notebook của bạn.

- Chọn Stop nếu nó đang chạy.

- Sau khi nó đã dừng, chọn Delete.

Kết luận

Bài đăng này nêu bật cách kết hợp Strands Agents SDK với các mô hình Llama 4 của Meta và cơ sở hạ tầng Amazon Bedrock cho phép xây dựng các quy trình xử lý video đa tác nhân tiên tiến. Bằng cách sử dụng các tác nhân chuyên biệt cao giao tiếp và cộng tác thông qua mô hình Agents as Tools, các nhà phát triển có thể mô-đun hóa các tác vụ phức tạp như trích xuất khung hình, phân tích hình ảnh, suy luận thời gian và tóm tắt. Việc phân tách mối quan tâm này giúp tăng cường khả năng bảo trì, tùy chỉnh và khả năng mở rộng trong khi cho phép tích hợp liền mạch trên các dịch vụ AWS.

Chúng tôi khuyến khích các nhà phát triển khám phá và mở rộng kiến trúc này bằng cách thêm các tác nhân chuyên biệt mới và điều chỉnh quy trình làm việc cho các trường hợp sử dụng đa dạng—từ thành phố thông minh và tự động hóa công nghiệp đến quản lý nội dung truyền thông. Sự kết hợp giữa Strands Agents, Llama 4 của Meta và Amazon Bedrock đặt nền tảng vững chắc để tạo ra các giải pháp AI tự chủ, linh hoạt nhằm giải quyết sự phức tạp của môi trường kinh doanh hiện đại.

Để bắt đầu, hãy truy cập kho lưu trữ GitHub chính thức cho dự án tác nhân Meta-Llama-on-AWS để xem các ví dụ mã và hướng dẫn triển khai. Để biết thêm thông tin chi tiết về việc xây dựng với Strands Agents, hãy khám phá tài liệu Strands Agents, cung cấp cách tiếp cận ưu tiên mã để tích hợp các tác nhân AI mô-đun. Để có ngữ cảnh rộng hơn về kiến trúc AI đa tác nhân và điều phối, các bài đăng trên blog AWS về khả năng tương tác của tác nhân và các framework tác nhân tự chủ cung cấp hướng dẫn có giá trị định hình tương lai của các hệ thống thông minh.

Về tác giả

Sebastian Bustillo là Kiến trúc sư Giải pháp Doanh nghiệp tại Amazon Web Services (AWS), làm việc với các hãng hàng không và là thành viên tích cực của Cộng đồng Kỹ thuật AI/ML. Tại AWS, anh ấy giúp khách hàng khai thác giá trị kinh doanh thông qua AI. Ngoài công việc, anh ấy thích dành thời gian cho gia đình và khám phá thiên nhiên. Anh ấy cũng đam mê pha chế cà phê đặc biệt.