Tác giả: Surya Kari, Joseph Moulton, Joel Carlson, Mona Mona, Morteza Ziyadi, Pradeep Natarajan, Rajkumar Pujari, and Swastik Roy

Ngày phát hành: 06 FEB 2026

Chuyên mục: Amazon Nova, Amazon SageMaker AI, Announcements, Best Practices, Technical How-to

Trong bài viết Đánh giá các mô hình AI tạo sinh bằng Amazon Nova LLM-as-a-Judge trên Amazon SageMaker AI, chúng tôi đã giới thiệu khả năng LLM-as-a-judge của Amazon Nova, một mô hình đánh giá chuyên biệt có sẵn thông qua Amazon SageMaker AI mà bạn có thể sử dụng để đo lường hiệu suất tương đối của các hệ thống AI tạo sinh một cách có hệ thống.

SageMaker AI hiện cung cấp một trọng tài Large Language Model (LLM) dựa trên tiêu chí được hỗ trợ bởi Amazon Nova. Thay vì sử dụng cùng một bộ quy tắc chung cho mọi tác vụ, nó tự động tạo ra các tiêu chí đánh giá cụ thể cho từng lời nhắc riêng lẻ. Điều này giúp các nhà phát triển AI tạo sinh và kỹ sư Machine Learning (ML) tự động tạo ra các tiêu chí đánh giá chính xác, cụ thể theo kịch bản cho các LLM và sản phẩm AI tạo sinh của họ, mà không cần phải tự tay xây dựng các bộ quy tắc cho từng trường hợp sử dụng.

Trong bài viết này, chúng tôi khám phá tính năng trọng tài dựa trên tiêu chí của Amazon Nova: trọng tài dựa trên tiêu chí là gì, cách trọng tài được huấn luyện, các chỉ số cần xem xét và cách hiệu chỉnh trọng tài. Chúng tôi chia sẻ mã notebook của phương pháp LLM-as-a-judge dựa trên tiêu chí của Amazon Nova để đánh giá và so sánh đầu ra của hai LLM khác nhau bằng cách sử dụng các tác vụ huấn luyện SageMaker.

Tổng quan về trọng tài Amazon Nova dựa trên tiêu chí

Một trọng tài LLM dựa trên tiêu chí sử dụng một LLM có khả năng cao (cụ thể là Amazon Nova) để đóng vai trò là trọng tài cho các phản hồi được tạo bởi các mô hình AI khác hoặc phản hồi do con người tạo ra. Khả năng này cung cấp các so sánh theo cặp giữa các lần lặp mô hình, giúp bạn đưa ra các quyết định dựa trên dữ liệu về cải tiến mô hình một cách tự tin. Tiêu chí (rubric) là một hướng dẫn chấm điểm được sử dụng để đánh giá hiệu suất. Theo truyền thống, để đánh giá một mô hình AI, con người sẽ tự tay viết một danh sách kiểm tra các quy tắc (một tiêu chí tĩnh) áp dụng cho mọi tác vụ. Ví dụ: “Câu trả lời có lịch sự không?” hoặc “Câu trả lời có ngắn gọn không?”. Thách thức với cách tiếp cận này là các quy tắc chung này không thể mở rộng cho tất cả người dùng. Một lời nhắc viết sáng tạo cần các tiêu chí chấm điểm khác với một lời nhắc viết mã hoặc một bản tóm tắt pháp lý, thay vì một danh sách kiểm tra chung. Trọng tài được hỗ trợ bởi Amazon Nova tạo ra một danh sách kiểm tra tùy chỉnh cho các tương tác khác nhau. Người dùng gửi một lời nhắc cụ thể đến hệ thống (ví dụ: “Tóm tắt tài liệu y tế này cho bệnh nhân”). Trọng tài phân tích lời nhắc cụ thể đó và quyết định ngay lập tức một câu trả lời lý tưởng sẽ trông như thế nào. Nó tự động viết các tiêu chí như sau:

- Nó có sử dụng thuật ngữ đơn giản, không chuyên ngành y tế không?

- Nó có nắm bắt chính xác chẩn đoán không?

- Giọng điệu có đồng cảm không?

Trọng tài sau đó xem xét đầu ra được tạo bởi mô hình LLM của bạn và chấm điểm nó dựa trên các tiêu chí cụ thể mà nó vừa tạo. Bạn nhận được điểm chất lượng dựa trên các quy tắc phù hợp với tác vụ cụ thể đó, không phải các quy tắc chung chung.

Ví dụ đầu vào

Đối với ví dụ lời nhắc hoặc đầu vào “do dinosaurs really exist?”, chúng ta có hai phản hồi như trong bảng sau.

| Response A | Response B |

|---|---|

| The simple answer is: Yes, dinosaurs absolutely existed, but they do not exist today (except for their bird descendants). Here’s a breakdown of what that means: 1. Dinosaurs Were Very Real For over 150 million years, dinosaurs were the dominant land animals on Earth. We know they existed because we have an enormous amount of proof: Fossils: We have found millions of dinosaur fossils—bones, teeth, skulls, and claws—all over the world. These aren’t myths; they are the actual preserved remains of these animals. Footprints: We have discovered countless fossilized trackways, which are footprints left in mud that later turned to stone. These tell us how dinosaurs walked, ran, and lived in groups. Eggs and Nests: Paleontologists have found fossilized dinosaur eggs and nests, showing us how they reproduced. Even Soft Tissues: In some extremely rare cases, scientists have found evidence of feathers, skin impressions, and even chemical traces of proteins from dinosaurs. 2. But They Are Extinct (Most of Them) About 66 million years ago, a massive asteroid struck the Earth (in what is now the Gulf of Mexico). This caused a catastrophic event that led to the extinction of all non-avian dinosaurs—that is, all dinosaurs except for the ones that could fly. 3. Their Descendants Are All Around Us: Birds! This is the most exciting part of the answer! Birds are actually a type of dinosaur. Think of it this way: The dinosaur group is huge. T. rex, Triceratops, and Brachiosaurus are all famous members. Another branch of the dinosaur family tree were small, feathered dinosaurs. One group of these feathered dinosaurs evolved the ability to fly. They are the direct ancestors of all modern birds. So, when you see a pigeon on the street or a chicken on your plate, you are looking at a living dinosaur. In summary: Did dinosaurs exist? Yes, overwhelmingly, we have proof they were real animals.Do they exist today? Not in the form of T. rex or Stegosaurus. Those specific types are extinct.But wait! Their direct descendants, the birds, are everywhere. So, in a very real scientific sense, dinosaurs are still with us today. | Yes, dinosaurs did really exist — but not today. Dinosaurs were a diverse group of reptiles that lived on Earth millions of years ago, primarily during the Mesozoic Era, which spanned from about 252 million years ago to 66 million years ago. Fossil evidence — including bones, footprints, eggs, and even skin impressions — confirms that dinosaurs once roamed the planet. Scientists have identified hundreds of dinosaur species, ranging from the massive Tyrannosaurus rex and long-necked Brachiosaurus to smaller, agile predators like Velociraptor. Most non-avian dinosaurs went extinct around 66 million years ago, likely due to a massive asteroid impact combined with volcanic activity and climate change. However, one group of dinosaurs survived: the ancestors of modern birds. So in a scientific sense, birds are living dinosaurs, making them the closest living relatives to extinct dinosaurs like T. rex and Triceratops. So while you won’t see a Stegosaurus walking around today, the legacy of dinosaurs lives on — especially every time you see a sparrow or eagle fly by.   |

Ví dụ đầu ra

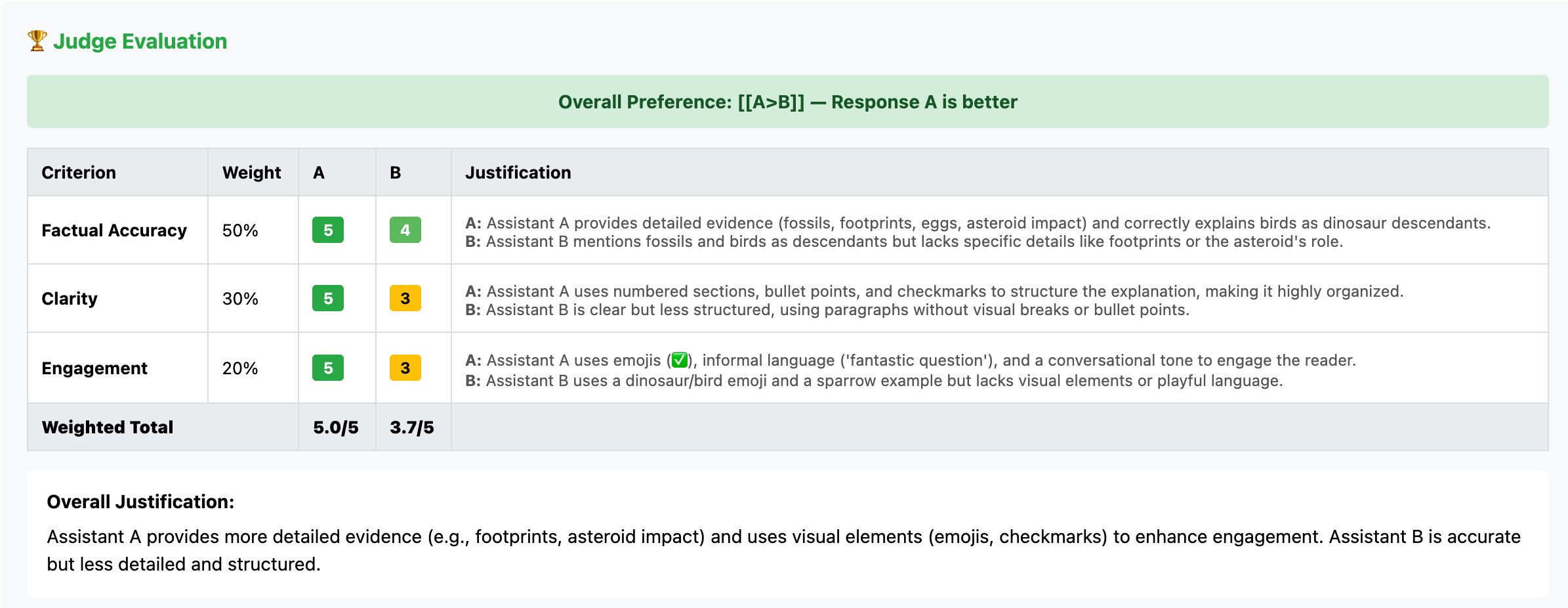

Trong số hai phản hồi, trọng tài dựa trên tiêu chí ưu tiên Phản hồi A và cũng cung cấp lý do tại sao nó ưu tiên phản hồi A hơn phản hồi B, như trong ảnh chụp màn hình sau.

Việc đánh giá được điều chỉnh theo đúng ý định của lời nhắc của người dùng (viết mã so với viết văn so với tóm tắt). Các nhà phát triển AI tạo sinh, nhà khoa học dữ liệu và kỹ sư ML không phải dành hàng trăm giờ để tự tay viết các quy tắc đánh giá cho mọi kịch bản có thể. Bạn có thể đánh giá hàng nghìn loại lời nhắc khác nhau ngay lập tức, đạt được chất lượng cao trên nhiều trường hợp sử dụng đa dạng.

Các ví dụ triển khai trong doanh nghiệp

Trọng tài LLM dựa trên tiêu chí của Amazon Nova giải quyết các thách thức đánh giá quan trọng trong các kịch bản khác nhau:

- Phát triển mô hình và lựa chọn checkpoint – Các nhóm phát triển tích hợp đánh giá trọng tài dựa trên tiêu chí của Amazon Nova vào các pipeline huấn luyện để tự động đánh giá các checkpoint. Điểm số theo tiêu chí tiết lộ khả năng nào được củng cố hoặc suy giảm qua các lần lặp, cho phép đưa ra các quyết định dựa trên dữ liệu về điều chỉnh siêu tham số và quản lý dữ liệu.

- Kiểm soát chất lượng dữ liệu huấn luyện – Các nhóm sử dụng đánh giá trọng tài dựa trên tiêu chí của Amazon Nova để lọc các tập dữ liệu fine-tuning có giám sát bằng cách tạo điểm số theo từng điểm trên các tiêu chí liên quan, xác định các ví dụ chất lượng thấp. Đối với các tập dữ liệu ưu tiên, các biên được tính toán giữa các cặp phản hồi cho phép các chiến lược học tập theo chương trình lọc các ví dụ quá một chiều cung cấp tín hiệu học tập hạn chế.

- Phân tích chuyên sâu và phân tích nguyên nhân gốc tự động – Các tổ chức triển khai AI tạo sinh ở quy mô lớn có thể sử dụng đánh giá trọng tài dựa trên tiêu chí của Amazon Nova để phân tích có hệ thống trên hàng nghìn đầu ra mô hình mà không cần xem xét thủ công. Khi các mô hình gặp vấn đề về chất lượng, các nhà phát triển có thể kiểm tra các tiêu chí cụ thể nào thúc đẩy các phán đoán ưu tiên, xác định các điểm yếu có hệ thống để thông báo các cải tiến có mục tiêu thay vì các nỗ lực huấn luyện lại rộng rãi.

Cách tạo tiêu chí động hoạt động

Trọng tài LLM dựa trên tiêu chí của Amazon Nova nhận đầu vào là một bộ ba: <prompt, response_1, response_2>. Trọng tài so sánh chất lượng của hai phản hồi cho lời nhắc đã cho và xuất ra một nhãn ưu tiên. Ngoài nhãn tổng thể, trọng tài còn tạo ra một lý do cho quyết định của mình, được hướng dẫn bởi một tiêu chí.

Tiêu chí là một tập hợp các tiêu chí có trọng số được sử dụng để đánh giá hai phản hồi. Trọng tài LLM dựa trên tiêu chí được huấn luyện để tạo ra các tiêu chí với trọng số tổng bằng 1. Mỗi tiêu chí trong tiêu chí có một short_name, description và weight. Quyết định của trọng tài bao gồm điểm cho mỗi phản hồi trên mỗi tiêu chí trong tiêu chí cùng với các lý do cho các điểm số.

Trọng tài LLM dựa trên tiêu chí của Amazon Nova sử dụng một phương pháp đánh giá trong đó mỗi phán đoán được hỗ trợ bởi các tiêu chí được tạo động, cụ thể theo lời nhắc. Khi trọng tài nhận được yêu cầu đánh giá chứa một lời nhắc và các phản hồi ứng cử viên, nó phân tích lời nhắc để hiểu ngữ cảnh lời nhắc và tạo ra các tiêu chí dựa trên ngữ cảnh đó. Quá trình tạo động này đảm bảo các đánh giá được dựa trên các tiêu chí áp dụng trực tiếp cho tác vụ đang thực hiện, cung cấp các đánh giá minh bạch và dễ hiểu.

Đối với mỗi lần đánh giá, trọng tài tạo ra đầu ra YAML có cấu trúc chứa các tiêu chí được tạo với định nghĩa của chúng, điểm số theo tiêu chí trên thang điểm 1–5 và các lý do chi tiết giải thích từng điểm số. Đầu ra cuối cùng bao gồm một trong bốn nhãn ưu tiên: [[A>B]], [[B>A]], [[A=B]], hoặc [[A=B (bothbad)]. Mỗi điểm tiêu chí được kèm theo một lý do giải thích đánh giá dựa trên các đặc điểm có thể quan sát được của các phản hồi, cho phép phân tích chuyên sâu và gỡ lỗi hành vi của mô hình.

So sánh Amazon Nova LLM-as-a-judge dựa trên tiêu chí với các phiên bản trước

Trọng tài dựa trên tiêu chí khác với các phiên bản trước ở cách nó trình bày kết quả đánh giá và thông tin nó cung cấp.

Phiên bản trước của mô hình Amazon Nova LLM-as-a-judge trả về các nhãn ưu tiên đơn giản ([[A>B]] hoặc [[B>A]]). Phiên bản dựa trên tiêu chí tạo ra một đầu ra YAML có cấu trúc bao gồm những điều sau:

- Một tiêu chí cụ thể theo lời nhắc để đánh giá các phản hồi được tổ chức dưới dạng một tập hợp các tiêu chí với các trọng số quan trọng theo tiêu chí liên quan (tổng trọng số bằng 1)

- Các mô tả ngôn ngữ tự nhiên ngắn gọn của mỗi tiêu chí

- Điểm Likert (trên thang điểm 1–5) hoặc quyết định nhị phân (đúng/sai) cho mỗi tiêu chí cho mỗi phản hồi ứng cử viên trong đầu vào

- Lý do cho mỗi điểm tiêu chí cho mỗi phản hồi ứng cử viên

- Phán đoán ưu tiên tổng thể: một trong A>B, B>A, A=B, hoặc A=B (cả hai đều tệ)

Định dạng đầu ra chi tiết mới tạo điều kiện cho một loạt các trường hợp sử dụng tinh tế. Ví dụ, các tiêu chí cụ thể trong các tiêu chí cho phép so sánh các phản hồi một cách rõ ràng. Một phản hồi ngắn gọn có thể phù hợp hơn cho một số trường hợp sử dụng nhất định, trong khi một phản hồi toàn diện có thể cần thiết trong các trường hợp khác. Các lý do và chấm điểm tiêu chí rõ ràng giúp người dùng loại bỏ một số tiêu chí không phù hợp với nhu cầu của họ và tính toán lại các phán đoán ưu tiên mà không cần chạy lại truy vấn thông qua trọng tài LLM.

Giải thích các chỉ số

Trong quá trình đánh giá trọng tài của chúng tôi, chúng tôi sử dụng một số chỉ số quan trọng để làm điểm so sánh để xếp hạng chất lượng trọng tài. Thỏa thuận thuận chiều (Forward agreement) là một chỉ số tính toán sự đồng thuận với ưu tiên của con người với phản hồi được chọn và phản hồi bị từ chối theo một thứ tự cụ thể, đảm bảo nhãn chính xác luôn là một trong A>B hoặc B>A cho toàn bộ tập dữ liệu. Bởi vì tính nhất quán vị trí là một thuộc tính mong muốn quan trọng của một trọng tài LLM đáng tin cậy, chúng tôi đánh giá các checkpoint của mình dựa trên thỏa thuận đã điều chỉnh (reconciled agreement)—nghĩa là, chúng tôi thu được hai phán đoán với các phản hồi được trình bày cho trọng tài theo cả hai thứ tự có thể (đối với hai phán đoán ưu tiên phản hồi). Chúng tôi chỉ ghi nhận trọng tài có câu trả lời đúng nếu trọng tài đồng ý theo cả hai hướng và phán đoán khớp với ưu tiên của con người. Con số này, theo định nghĩa, sẽ luôn thấp hơn thỏa thuận thuận chiều. Tuy nhiên, vì các tập dữ liệu trong thế giới thực không được sắp xếp, nó cung cấp một proxy chính xác hơn cho hiệu suất thực tế của mô hình trọng tài LLM.

Điểm số có trọng số (weighted_score_A và weighted_score_B) là các chỉ số mới được thêm vào đầu ra đánh giá trọng tài dựa trên tiêu chí, cung cấp cái nhìn sâu sắc về độ tin cậy của phán đoán. Sự khác biệt lớn giữa các điểm số có trọng số cho thấy sự ưu tiên mạnh mẽ cho một phản hồi hơn phản hồi kia. Các điểm số này được tính toán cho mỗi mẫu dựa trên các điểm được gán cho mỗi tiêu chí trong tiêu chí. Mỗi điểm tiêu chí được chuẩn hóa thành phạm vi 0–1 (trong đó điểm thang điểm 1–5 ánh xạ tới 0.0–1.0, và nhị phân True/False ánh xạ tới 1.0/0.0), sau đó nhân với trọng số của tiêu chí và tổng hợp để tạo ra các điểm số có trọng số cho mỗi phản hồi.

score_margin cho thấy sự khác biệt giữa các điểm số có trọng số, với các giá trị âm cho thấy sự ưu tiên đối với phản hồi B và các giá trị dương cho thấy sự ưu tiên đối với phản hồi A. Trong đầu ra đánh giá cuối cùng, các chỉ số này được báo cáo dưới dạng trung bình trên tất cả các mẫu. Các phân tích chi tiết theo tiêu chí trên mỗi mẫu, điểm số riêng lẻ và lý do có thể được tìm thấy trong tệp đầu ra Parquet chi tiết.

Đối với mỗi mẫu so sánh, chúng ta có thể nhận được các tiêu chí cụ thể mà mô hình trọng tài dựa trên tiêu chí mới đã sử dụng trong quá trình so sánh hai kết quả, trông giống như ví dụ mã sau:

================================================================================Row 1: Preference: ['B>A'] A wins: 0.0 B wins: 2.0 Weighted A: 0.225 Weighted B: 1.000 Margin: -0.775 Overall Justification: Response B provides a comprehensive and detailed explanation of photosynthesis, covering the process, location, chemical equation, and importance. Response A only provides a brief, surface-level description without explaining the mechanism or significance. Criteria: completeness: Score A: 2, Score B: 5 Weight: 0.5, Type: scale Description: How thoroughly the response explains the photosynthesis process. Justification A: Response A mentions the basic inputs and outputs but lacks detail on the mechanism, location in the cell, or the chemical equation. Justification B: Response B provides a complete explanation including the process, chloroplasts, chemical equation, and the importance to life on Earth. clarity: Score A: 3, Score B: 5 Weight: 0.3, Type: scale Description: How clearly the response communicates the concept. Justification A: Response A is clear but overly simplistic, lacking the detail needed for full understanding. Justification B: Response B is well-structured and clearly explains each component of photosynthesis in an accessible way. accuracy: Score A: 4, Score B: 5 Weight: 0.2, Type: scale Description: How accurate the scientific information is. Justification A: Response A is accurate in what it states but incomplete. Justification B: Response B is fully accurate and includes the correct chemical equation and scientific terminology.================================================================================

Các chỉ số có trọng số này mang tính thông tin và cung cấp cái nhìn định lượng về phân tích điểm số, nhưng quyết định ưu tiên thực tế (A>B, B>A, hoặc A=B) xác định số lần thắng cuối cùng dựa trên đầu ra ưu tiên tổng thể của mô hình trọng tài.

Phương pháp huấn luyện cho trọng tài

Trọng tài dựa trên tiêu chí của Amazon Nova được huấn luyện với một gói phần thưởng đa khía cạnh. Trong phương pháp huấn luyện của chúng tôi, chúng tôi tối ưu hóa một số đặc điểm mong muốn cho một trọng tài LLM bằng cách sử dụng một công thức phần thưởng hiệu quả. Chúng tôi chủ yếu nhắm mục tiêu các tiêu chí sau:

- Độ chính xác ưu tiên – Trọng tài được thưởng khi nó đưa ra các quyết định phù hợp với ưu tiên vàng của con người. Khi nó chọn một phản hồi hơn phản hồi khác, mô hình sẽ được thưởng.

- Tính nhất quán vị trí – Các quyết định của trọng tài được huấn luyện để có khả năng phục hồi đối với các vấn đề không nhất quán vị trí với một thứ tự phản hồi ứng cử viên cụ thể.

- Chất lượng lý do – Các lý do của trọng tài để đưa ra quyết định phải phù hợp với các tiêu chí, điểm số và phán đoán cuối cùng được tạo ra.

- Hiệu chỉnh điểm số – Các điểm số có trọng số cho các phản hồi phải được hiệu chỉnh với độ chính xác quyết định (các phán đoán có độ tin cậy cao phải đúng thường xuyên hơn các phán đoán có độ tin cậy thấp).

Chúng tôi bắt đầu với dữ liệu ưu tiên được chú thích bởi con người và sử dụng thiết lập lọc dữ liệu tùy chỉnh và tạo dữ liệu tổng hợp để thu được các lý do ưu tiên phù hợp với tiêu chí. Chúng tôi lấy mẫu từ các tiêu chí tổng hợp được tạo và phát triển một pipeline tùy chỉnh để huấn luyện trọng tài LLM dựa trên tiêu chí của Amazon Nova để tạo ra các tiêu chí phù hợp một cách thành thạo với độ chi tiết chính xác cho việc ra quyết định nhất quán và mạnh mẽ.

Hiệu suất benchmark

Kiểm tra trên các tập dữ liệu đánh giá tiêu chuẩn cho thấy những cải tiến, đặc biệt là trên các tác vụ yêu cầu phán đoán tinh tế, như trong bảng sau.

| Benchmark | Previous Amazon Nova Judge | New Amazon Nova Rubric-Based Judge |

|---|---|---|

| PPE | 0.61 | 0.64 |

| RMBench | 0.66 | 0.88 |

| RewardBench | 0.88 | 0.9 |

| JudgeBench | 0.51 | 0.76 |

| CodeUltraFeedback | 0.69 | 0.72 |

| MMEval | 0.8 | 0.84 |

Những cải tiến lớn hơn trên JudgeBench và RMBench phản ánh khả năng xử lý tốt hơn các kịch bản đánh giá phức tạp.

Hiệu chỉnh

Trong quá trình huấn luyện cũng như trong quá trình xử lý hậu kỳ, chúng tôi đánh giá khả năng của trọng tài dựa trên tiêu chí của Amazon Nova để đưa ra các quyết định được hiệu chỉnh tốt. Để đạt được hiệu chỉnh cân bằng, chúng tôi xem xét các nhóm độ tin cậy trên một tập dữ liệu ưu tiên được chú thích bởi con người. Chúng tôi xem xét sự khác biệt của các điểm số có trọng số cho các cặp phản hồi. Chúng tôi hướng tới việc hiệu chỉnh độ tin cậy theo độ chính xác. Lý tưởng nhất, trọng tài LLM nên chính xác hơn khi đưa ra các quyết định có độ tin cậy cao và được phép kém chính xác hơn khi đưa ra các quyết định có độ tin cậy thấp. Chúng tôi nhận thấy rằng phương pháp hiệu chỉnh này dẫn đến việc ra quyết định nhất quán trong và ngoài các tập dữ liệu phân phối. Chúng tôi cũng xem xét phân phối điểm số được tạo cho các tiêu chí khác nhau. Chúng tôi tìm kiếm một phân phối gần như chuẩn trên thang điểm Likert (1–5) trên tập dữ liệu đánh giá. Quá trình kiểm tra hiệu chỉnh hai hướng này giúp chúng tôi xác định các checkpoint trọng tài LLM tốt hơn trong số một số checkpoint có hiệu suất tương tự tốt.

Các trường hợp sử dụng phán đoán dựa trên tiêu chí

Độ tin cậy của các tiêu chí được tạo động bắt nguồn từ ba quyết định:

- Trọng tài được huấn luyện trên dữ liệu ưu tiên được chú thích bằng tiêu chí đa dạng, chất lượng cao, đại diện cho các trường hợp sử dụng trong thế giới thực, dạy nó các mẫu phân biệt các tiêu chí đánh giá hiệu quả với các tiêu chí hời hợt.

- Cơ chế lọc của chúng tôi trong quá trình huấn luyện ưu tiên các tiêu chí thể hiện các thuộc tính mong muốn—tính toàn diện, tính loại trừ lẫn nhau, tính cụ thể phù hợp và tính liên quan đến tác vụ—đảm bảo mô hình học hỏi từ những ví dụ tốt nhất.

- Công thức phần thưởng của chúng tôi trực tiếp khuyến khích chất lượng tiêu chí: các tiêu chí dẫn đến các ưu tiên chính xác, bất biến vị trí với độ tin cậy được hiệu chỉnh tốt sẽ nhận được phần thưởng tích cực, trong khi những tiêu chí tạo ra các phán đoán không nhất quán sẽ bị phạt.

Cách sử dụng tiêu chí để cải thiện các ứng dụng thực tế

Nhiều ứng dụng hiện đại hoạt động trong môi trường không có tham chiếu, nơi không tồn tại câu trả lời vàng chuẩn của con người. Trong những trường hợp này, tính hữu ích của tiêu chí là tối quan trọng. Trong phần này, chúng tôi nêu bật các trường hợp mà các tiêu chí được tạo bởi trọng tài của chúng tôi có thể là đầu vào hữu ích cho việc ra quyết định có thông tin. Chúng tôi chứng minh cách đầu ra của trọng tài dựa trên tiêu chí của chúng tôi—cụ thể là các tiêu chí có trọng số, điểm số chi tiết và lý do rõ ràng—đóng vai trò là cơ chế kiểm soát quan trọng.

Đánh giá hệ thống RAG

Trong Retrieval Augmented Generation (RAG), chế độ lỗi chính là ảo giác. Các trọng tài ưu tiên truyền thống thường gộp “phản hồi có tốt không?” với “có trôi chảy không?”, “có định dạng tốt không?”, “logic nội bộ có đúng không?”, v.v. Một phản hồi trôi chảy nhưng không chính xác về mặt thực tế thường được coi là đáng tin cậy hơn một phản hồi rời rạc chứa thông tin chính xác. Một đánh giá tập trung vào tính xác thực có thể giúp bạn chọn một mô hình tóm tắt vì kết quả truy xuất không có ảo giác. Sử dụng trọng tài dựa trên tiêu chí cho các phán đoán như vậy có thể giúp hiểu liệu phán đoán ưu tiên có dựa trên các tiêu chí như tính trôi chảy và định dạng, hay phán đoán dựa trên các tiêu chí liên quan như tính trung thực, tính liên quan đến ngữ cảnh, v.v. Người dùng có thể bỏ qua điểm số của các tiêu chí không liên quan và đánh giá lại các phán đoán dựa trên một tập hợp con các tiêu chí mà họ quan tâm cho ứng dụng của mình.

Nhà phê bình sáng tạo

Trong ví dụ này, chúng ta nhìn theo hướng khác, nơi sự sáng tạo và độc đáo được mong muốn hơn tính trung thực với các sự kiện trong thế giới thực hoặc ngữ cảnh trước đó. Hãy xem xét một trường hợp sử dụng nơi bạn đang sử dụng một LLM để tạo ra các câu chuyện ngắn hoặc kịch bản độc đáo, nhưng người dùng cung cấp một vài ví dụ về các kịch bản trước đây để minh họa các yêu cầu. Việc chọn các đầu ra tốt từ các thế hệ này yêu cầu các câu chuyện được tạo ra phải đủ khác biệt so với các ví dụ, sáng tạo, độc đáo và không vay mượn trực tiếp từ dữ liệu huấn luyện hiện có. Người dùng cuối có thể tập trung vào các tiêu chí như tính độc đáo, tính mạch lạc và tính hấp dẫn để tối ưu hóa các phán đoán ưu tiên phù hợp với trường hợp sử dụng này, khi sử dụng trọng tài dựa trên tiêu chí của chúng tôi. Bạn có thể xem xét thêm các lý do rõ ràng cho điểm số tiêu chí cho loại độc đáo và sáng tạo cụ thể được mong muốn.

Tổng quan giải pháp

Giải pháp này minh họa cách đánh giá các mô hình AI tạo sinh trên SageMaker AI bằng cách sử dụng khả năng trọng tài dựa trên tiêu chí. Bạn cũng có thể đánh giá các phản hồi do con người tạo ra, nhưng trong giải pháp này, chúng tôi chỉ ra cách bạn có thể đánh giá các phản hồi được tạo bởi các LLM khác như mô hình Qwen bằng cách sử dụng Amazon Nova làm trọng tài dựa trên tiêu chí.

Đầu tiên, chúng tôi chuẩn bị một tập dữ liệu bằng cách lấy mẫu các câu hỏi từ Stanford Question Answering Dataset (SQuAD) và tạo các phản hồi ứng cử viên từ cả Qwen2.5 1.5B Instruct và Qwen2.5 7B Instruct. Cả hai mô hình đều được truy cập thông qua các endpoint Hugging Face được lưu trữ trên SageMaker. Các phản hồi từ cả hai mô hình được lưu trong một tệp JSONL (llm_judge.jsonl) chứa lời nhắc, response_A (từ Qwen2.5 1.5B Instruct) và response_B (từ Qwen2.5 7B Instruct).

Tiếp theo, tệp JSONL được tải lên một bucket Amazon Simple Storage Service (Amazon S3). Một PyTorch Estimator sau đó khởi chạy một tác vụ đánh giá bằng cách sử dụng công thức LLM-as-a-judge dựa trên tiêu chí của Amazon Nova. Mô hình trọng tài tự động tạo ra các tiêu chí và tiêu chí đánh giá được điều chỉnh cho từng tác vụ, sau đó so sánh hai phản hồi ứng cử viên với các tiêu chí này. Tác vụ chạy trên các phiên bản GPU như ml.g5.12xlarge và tạo ra các chỉ số đánh giá, bao gồm điểm số theo tiêu chí, lý do, đánh giá so sánh, số lượng ưu tiên và các biện pháp độ tin cậy. Kết quả được lưu vào Amazon S3 để phân tích.

Cuối cùng, một hàm trực quan hóa hiển thị các biểu đồ và bảng, tóm tắt các tiêu chí được tạo, phân phối điểm số trên các chiều đánh giá, hiệu suất so sánh giữa hai mô hình Qwen2.5 và các ví dụ chi tiết với lý do. Thông qua cách tiếp cận từ đầu đến cuối này, bạn có thể đánh giá mô hình nào hoạt động tốt hơn, xác định các điểm mạnh và điểm yếu cụ thể, theo dõi các cải tiến và đưa ra các quyết định dựa trên dữ liệu về việc triển khai các mô hình tạo sinh—tất cả mà không cần chú thích thủ công.

Điều kiện tiên quyết

Bạn phải hoàn thành các điều kiện tiên quyết sau trước khi có thể chạy notebook:

- Thực hiện các yêu cầu tăng hạn ngạch sau cho SageMaker AI. Đối với trường hợp sử dụng này, bạn phải yêu cầu (trên bảng điều khiển Service Quotas) tối thiểu hai phiên bản g5.12xlarge cho việc sử dụng endpoint và ít nhất một phiên bản g5.12xlarge cho việc sử dụng tác vụ huấn luyện.

- (Tùy chọn) Bạn có thể tạo một miền Amazon SageMaker Studio (tham khảo Sử dụng thiết lập nhanh cho Amazon SageMaker AI) để truy cập Jupyter notebooks với vai trò IAM đã nói ở trên. (Bạn cũng có thể sử dụng JupyterLab trong thiết lập cục bộ của mình.)

a. Tạo một [vai trò](https://docs.aws.amazon.com/sagemaker/latest/dg/sagemaker-roles.html#:~:text=the%20following%20procedures.-%5B%E2%80%A6%5Dxecution%20role,-Use%20the%20following%20(” rel=”noopener noreferrer” target=”_blank”) AWS Identity and Access Management (IAM) với các chính sách được quản lýAmazonSageMakerFullAccess,AmazonS3FullAccessvàAmazonBedrockFullAccessđể cấp quyền truy cập cần thiết cho SageMaker AI và Amazon Bedrock để chạy các ví dụ.

b. Trước khi tiếp tục, hãy đảm bảo cấp cho vai trò thực thi quyềns3:PutObjecttrực tiếp cho tiền tố bucket S3 của bạn dưới dạng một chính sách nội tuyến:

{"Effect": "Allow", "Action": ["s3:PutObject", "s3:GetObject", "s3:ListBucket"], "Resource": ["arn:aws:s3:::my-bucket-east", "arn:aws:s3:::my-bucket-east/*"]}

- Clone kho lưu trữ GitHub với các tài sản cho việc triển khai này. Kho lưu trữ này bao gồm một notebook tham chiếu các tài sản huấn luyện.

git clone https://github.com/aws-samples/amazon-nova-samples.gitcd customization/Nova_2.0/04_eval/Amazon-Nova-Rubric-Based-LLM-As-A-Judge

- Chạy notebook

Amazon-Nova-Rubric-LLM-as-a-Judge-Sagemaker-AI.ipynbđể bắt đầu sử dụng triển khai Amazon Nova LLM-as-a-judge trên SageMaker AI.

Cấu hình mô hình

Để thực hiện đánh giá Amazon Nova LLM-as-a-judge dựa trên tiêu chí, bạn phải tạo đầu ra từ cả hai mô hình ứng cử viên mà bạn muốn so sánh. Trong dự án này, chúng tôi triển khai Qwen2.5 1.5B Instruct và Qwen2.5 7B Instruct trên SageMaker để tạo ra các phản hồi sẽ được mô hình trọng tài Amazon Nova so sánh.

Cả hai mô hình đều là các mô hình ngôn ngữ đa ngôn ngữ mã nguồn mở được triển khai trên các endpoint SageMaker chuyên dụng. Điều này đạt được bằng cách sử dụng giao diện triển khai HuggingFaceModel. Để triển khai các mô hình Qwen2.5 1.5B Instruct và Qwen2.5 7B Instruct, chúng tôi cung cấp một script tiện lợi chấp nhận tên mô hình làm đối số:

python3 deploy_model_arg.py Qwen/Qwen2.5-1.5B-Instructpython3 deploy_model_arg.py Qwen/Qwen2.5-7B-Instruct

Chúng tôi cũng đã bao gồm khả năng kiểm tra cả hai mô hình đã triển khai này. Khi bạn đã triển khai các mô hình, bạn có thể chuyển sang tạo dữ liệu đánh giá cho Amazon Nova LLM-as-a-judge dựa trên tiêu chí.

Chuẩn bị tập dữ liệu

Để tạo một tập dữ liệu đánh giá thực tế để so sánh các mô hình Qwen, chúng tôi đã sử dụng SQuAD, một benchmark được sử dụng rộng rãi trong hiểu ngôn ngữ tự nhiên được phân phối theo giấy phép CC BY-SA 4.0. SQuAD bao gồm hàng nghìn cặp câu hỏi-trả lời được crowdsource bao gồm nhiều bài viết Wikipedia đa dạng. Bằng cách lấy mẫu từ tập dữ liệu này, chúng tôi đảm bảo rằng các lời nhắc đánh giá của chúng tôi phản ánh các tác vụ trả lời câu hỏi thực tế, chất lượng cao, đại diện cho các ứng dụng trong thế giới thực.

Chúng tôi bắt đầu bằng cách tải một tập hợp con nhỏ các ví dụ để giữ cho quy trình làm việc nhanh chóng và có thể tái tạo. Cụ thể, chúng tôi đã sử dụng thư viện datasets của Hugging Face để tải xuống và tải 20 ví dụ đầu tiên từ phân tách huấn luyện SQuAD:

from datasets import load_datasetsquad = load_dataset("squad", split="train[:20]")

Lệnh này truy xuất một lát cắt của tập dữ liệu đầy đủ, chứa 20 mục với các trường có cấu trúc bao gồm ngữ cảnh, câu hỏi và câu trả lời. Để xác minh nội dung và kiểm tra một ví dụ, chúng tôi đã in ra một câu hỏi mẫu và câu trả lời đúng của nó:

print(squad[3]["question"])print(squad[3]["answers"]["text"][0])

Đối với tập đánh giá, chúng tôi đã chọn sáu câu hỏi đầu tiên từ tập hợp con này: questions = [squad[i]["question"] for i in range(6)]

Tạo tập dữ liệu đánh giá

Sau khi chuẩn bị một tập hợp các câu hỏi đánh giá từ SQuAD, chúng tôi đã tạo đầu ra từ cả hai mô hình Qwen2.5 và tập hợp chúng thành một tập dữ liệu có cấu trúc để được sử dụng bởi quy trình làm việc Amazon Nova LLM-as-a-judge dựa trên tiêu chí. Tập dữ liệu này đóng vai trò là đầu vào cốt lõi cho các công thức đánh giá SageMaker AI. Để làm điều này, chúng tôi đã lặp lại từng lời nhắc câu hỏi và gọi hàm tạo cho cả hai endpoint SageMaker:

generate_response("qwen25-15b-instruct-endpoint", q)cho các hoàn thành từ mô hình Qwen2.5 1.5B Instructgenerate_response("qwen25-7b-instruct-endpoint", q)cho các hoàn thành từ mô hình Qwen2.5 7B Instruct

Đối với mỗi lời nhắc, quy trình làm việc đã cố gắng tạo một phản hồi từ mỗi mô hình. Mã sau đây gọi hai phiên bản khác nhau của mô hình Qwen 2.5. Điều này cho phép trọng tài LLM sau đó xác định xem mô hình lớn hơn có cung cấp độ chính xác tốt hơn đáng kể hay mô hình nhỏ hơn là đủ cho tác vụ.

# Define the output file path for the LLM judge datasetoutput_path = "llm_judge.jsonl"with open(output_path, "w") as f: for q in questions: try:# Generate response from Model A (1.5B parameter model) response_a = generate_response("qwen25-15b-instruct-endpoint", q) except Exception as e:# Fallback error message if the API call fails response_a = f"[Qwen2.5 generation failed: {e}]" try:# Generate response from Model B (7B parameter model) response_b = generate_response("qwen25-7b-instruct-endpoint", q) except Exception as e:# Fallback error message if the API call fails response_b = f"[ qwen25-7b generation failed: {e}]"# Construct a dictionary containing the prompt and both model responses row = { "prompt": q, "response_A": response_a, "response_B": response_b } f.write(json.dumps(row) + "\n")# Write the record to the JSONL file as a single lineprint(f"JSONL file created at: {output_path}")

Quy trình làm việc này đã tạo ra một tệp JSON Lines có tên llm_judge.jsonl. Mỗi dòng chứa một bản ghi đánh giá duy nhất có cấu trúc như sau:

{ "prompt": "What is the capital of France?", "response_A": "The capital of France is Paris.", "response_B": "Paris is the capital city of France."}

Sau đó, chúng tôi đã tải llm_judge.jsonl lên một bucket S3:

upload_to_s3( "llm_judge.jsonl", "s3://<YOUR_BUCKET_NAME>/datasets/byo-datasets-dev/custom-llm-judge/llm_judge.jsonl")

Khởi chạy tác vụ đánh giá Amazon Nova LLM-as-a-judge dựa trên tiêu chí

Sau khi chuẩn bị tập dữ liệu và tạo công thức đánh giá, bước cuối cùng là khởi chạy tác vụ huấn luyện SageMaker thực hiện đánh giá Amazon Nova LLM-as-a-judge dựa trên tiêu chí. Trong quy trình làm việc này, tác vụ huấn luyện hoạt động như một quy trình tự chứa, được quản lý hoàn toàn, tải mô hình trọng tài, xử lý tập dữ liệu so sánh, áp dụng các tiêu chí được tạo động và tạo ra các chỉ số đánh giá toàn diện tại vị trí Amazon S3 được chỉ định của bạn. Chúng tôi sử dụng lớp PyTorch estimator từ SageMaker Python SDK để đóng gói cấu hình cho lần chạy đánh giá. Estimator định nghĩa các tài nguyên tính toán, hình ảnh container, công thức đánh giá và đường dẫn đầu ra để lưu trữ kết quả:

estimator = PyTorch( output_path=output_s3_uri, base_job_name=job_name, role=role, instance_type=instance_type, training_recipe=recipe_path, sagemaker_session=sagemaker_session, image_uri=image_uri, disable_profiler=True, debugger_hook_config=False,)

Sau khi estimator được cấu hình, bạn khởi tạo tác vụ đánh giá bằng phương thức fit(). Lệnh gọi này gửi tác vụ đến mặt phẳng điều khiển SageMaker, cấp phát cụm tính toán (các phiên bản ml.g5.12xlarge) và bắt đầu xử lý tập dữ liệu đánh giá của bạn:

estimator.fit(inputs={"train": evalInput})

Tác vụ sẽ thực hiện so sánh dựa trên tiêu chí, với mô hình trọng tài Amazon Nova tự động tạo ra các tiêu chí đánh giá và chấm điểm cả hai đầu ra mô hình Qwen2.5. Kết quả, bao gồm điểm số theo tiêu chí, lý do và đánh giá so sánh, sẽ tự động được lưu vào đường dẫn đầu ra S3 được chỉ định của bạn để phân tích và trực quan hóa sau này.

Kết quả từ tác vụ đánh giá Amazon Nova LLM-as-a-judge dựa trên tiêu chí

Sau đây là một ví dụ kết quả cho một hàng của đánh giá. Trong ví dụ này, Assistant B là người chiến thắng rõ ràng vì nó ưu tiên thông tin có căn cứ, tinh tế hơn là tuyên bố cụ thể nhưng chưa được xác minh của Assistant A về 145 tờ báo. Trọng tài phạt Assistant A vì thiếu ngữ cảnh, dẫn đến điểm số thấp hơn đáng kể về độ chính xác và tính đầy đủ. Bằng cách áp dụng trọng số tùy chỉnh phân bổ 50% tổng điểm cho độ chính xác, đánh giá tính toán một biên có trọng số định lượng chính xác lý do tại sao phản hồi chi tiết, có thể xác minh của Assistant B lại vượt trội.

================================================================================Row 0: Preference: ['B>A'] A wins: 0.0 B wins: 1.0 Weighted A: 0.175 Weighted B: 0.875 Margin: -0.700 Overall Justification: Assistant B's response is more accurate and complete as it provides specific examples of student publications and acknowledges the variability in the number of publications. Assistant A's response, while providing a specific number, lacks context and explanation, making it less useful for understanding the situation. Criteria: accuracy: Score A: 2, Score B: 4 Weight: 0.5, Type: scale Description: How accurate the information provided is regarding the number of student newspapers at Notre Dame. Justification A: Assistant A provides a specific number (145) but does not offer any context or explanation for this number, making it difficult to assess its accuracy. Justification B: Assistant B provides a more nuanced answer, stating that there are at least three significant student publications but acknowledges that the number can vary. This response is more accurate given the dynamic nature of student publications. completeness: Score A: 1, Score B: 5 Weight: 0.3, Type: scale Description: How complete the response is in providing information about student newspapers at Notre Dame. Justification A: Assistant A's response is incomplete as it does not provide any context or examples of student newspapers at Notre Dame. Justification B: Assistant B's response is more complete as it provides examples of well-known student publications and acknowledges the variability in the number of publications. clarity: Score A: 2, Score B: 5 Weight: 0.2, Type: scale Description: How clear and understandable the response is. Justification A: Assistant A's response is clear in providing a number but lacks clarity in explaining what this number represents. Justification B: Assistant B's response is clear and understandable, providing examples and context to help the reader understand the number of student publications.

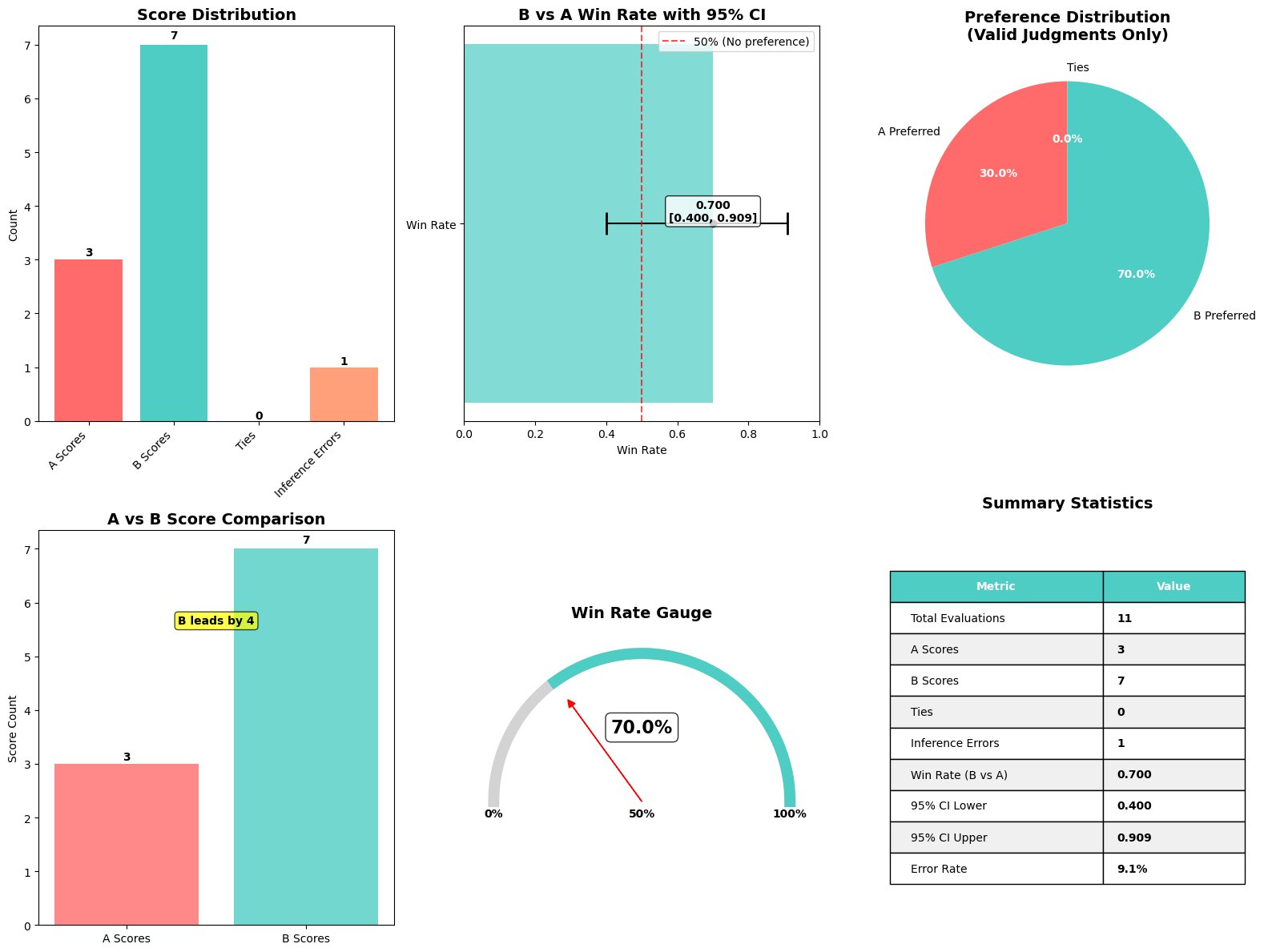

Như trong bài viết Đánh giá các mô hình AI tạo sinh bằng Amazon Nova LLM-as-a-Judge trên Amazon SageMaker AI, để giúp các nhà thực hành nhanh chóng diễn giải kết quả của đánh giá Amazon Nova LLM-as-a-judge dựa trên tiêu chí, chúng tôi đã tạo một hàm tiện ích tạo ra một hình ảnh trực quan toàn diện duy nhất tóm tắt các chỉ số chính, như trong ảnh chụp màn hình sau.

Hàm này, plot_nova_judge_results, sử dụng Matplotlib và Seaborn để hiển thị một hình ảnh với sáu bảng, mỗi bảng làm nổi bật một khía cạnh khác nhau của kết quả đánh giá.

Hàm này lấy từ điển chỉ số đánh giá được tạo ra khi tác vụ đánh giá hoàn tất và tạo ra các thành phần trực quan sau:

- Biểu đồ cột phân phối điểm – Cho thấy số lần Mô hình A được ưu tiên (ba lần thắng), số lần Mô hình B được ưu tiên (bảy lần thắng), số lần hòa xảy ra và tần suất trọng tài không đưa ra quyết định (một lỗi suy luận trong số 11 lần đánh giá). Điều này cung cấp một cảm giác ngay lập tức về mức độ quyết định của đánh giá, cho thấy rõ sự thống trị của Mô hình B với tỷ lệ ưu tiên 70%.

- Tỷ lệ thắng với khoảng tin cậy 95% – Vẽ tỷ lệ thắng tổng thể của Mô hình B là 70% so với Mô hình A, bao gồm một thanh lỗi phản ánh giới hạn khoảng tin cậy là [0.400, 0.909]. Một đường tham chiếu dọc ở 50% đánh dấu điểm không ưu tiên. Vì khoảng tin cậy không vượt qua đường này, chúng ta có thể kết luận kết quả có ý nghĩa thống kê, cho thấy sự vượt trội đáng kể của mô hình 7B.

- Biểu đồ tròn ưu tiên – Hiển thị trực quan tỷ lệ ưu tiên trong số 10 phán đoán hợp lệ: 70% cho Mô hình B và 30% cho Mô hình A. Điều này có thể giúp người dùng nhanh chóng hiểu phân phối ưu tiên rõ ràng ủng hộ mô hình lớn hơn.

- Biểu đồ cột so sánh điểm A so với B – So sánh số lượng ưu tiên thô cho mỗi mô hình cạnh nhau (ba cho Mô hình A so với bảy cho Mô hình B). Một nhãn rõ ràng chú thích biên độ khác biệt, nhấn mạnh lợi thế bốn lần thắng của Mô hình B. Biểu đồ cũng hiển thị điểm số dựa trên tiêu chí có trọng số: Mô hình A trung bình 0.495 trong khi Mô hình B trung bình 0.630 trên tất cả các tiêu chí đánh giá (độ chính xác, tính đầy đủ, tính rõ ràng), với biên độ trung bình -0.135 ủng hộ Mô hình B.

- Đồng hồ đo tỷ lệ thắng – Mô tả tỷ lệ thắng 70% dưới dạng đồng hồ đo hình bán nguyệt với kim chỉ hiệu suất của Mô hình B so với phạm vi lý thuyết 0–100%. Hình ảnh trực quan trực quan này giúp các bên liên quan không chuyên về kỹ thuật ngay lập tức nắm bắt rằng Mô hình B vượt trội hơn Mô hình A với biên độ đáng kể dựa trên các tiêu chí được tạo động được điều chỉnh cho từng cặp câu hỏi-trả lời.

- Bảng thống kê tóm tắt – Tổng hợp các chỉ số số vào một bảng nhỏ gọn, rõ ràng: 11 lần đánh giá tổng cộng, một lỗi (tỷ lệ lỗi 9.1%), tỷ lệ thắng 70%, điểm số dựa trên tiêu chí có trọng số (0.630 cho B so với 0.495 cho A với biên độ -0.135) và khoảng tin cậy [0.400, 0.909]. Điều này giúp dễ dàng tham chiếu các giá trị số chính xác đằng sau các biểu đồ và hiểu cả tính chặt chẽ thống kê và đánh giá dựa trên tiêu chí của đánh giá.

Vì hàm xuất ra một hình Matplotlib tiêu chuẩn, bạn có thể nhanh chóng lưu hình ảnh, hiển thị nó trong Jupyter notebooks hoặc nhúng nó vào các tài liệu khác. Hình ảnh trực quan cho thấy rõ ràng rằng Mô hình B cho thấy sự vượt trội có ý nghĩa thống kê tổng thể với điểm số dựa trên tiêu chí cao hơn trên các chiều độ chính xác, tính đầy đủ và tính rõ ràng.

Dọn dẹp

Để dừng và xóa các không gian SageMaker Studio, hãy làm theo các bước dọn dẹp này trong tài liệu SageMaker Studio. Bạn phải xóa bucket S3 và endpoint mô hình được lưu trữ để ngừng phát sinh chi phí. Bạn có thể xóa các endpoint thời gian thực mà bạn đã tạo bằng cách sử dụng bảng điều khiển SageMaker. Để biết hướng dẫn, hãy xem Xóa Endpoint và Tài nguyên.

Kết luận

Đánh giá đầu ra AI tạo sinh ở quy mô lớn đòi hỏi nhiều hơn là các nhãn ưu tiên đơn giản, nó đòi hỏi sự minh bạch về lý do tại sao một phản hồi vượt trội hơn phản hồi khác. Trọng tài LLM dựa trên tiêu chí của Amazon Nova giải quyết nhu cầu này bằng cách tự động tạo ra các tiêu chí đánh giá cụ thể theo tác vụ, cung cấp điểm số theo tiêu chí với lý do rõ ràng và cung cấp các tín hiệu độ tin cậy được hiệu chỉnh tốt. So với các triển khai trọng tài trước đây, cách tiếp cận dựa trên tiêu chí mang lại ba lợi thế chính: khả năng diễn giải thông qua đầu ra YAML có cấu trúc với phân tích cấp tiêu chí, tính linh hoạt cho phép người dùng điều chỉnh trọng số hoặc lọc tiêu chí cho các trường hợp sử dụng cụ thể của họ và độ chính xác được cải thiện với những cải tiến đáng kể trên các benchmark tiêu chuẩn—bao gồm cải thiện 49% trên các kịch bản đánh giá phức tạp trong JudgeBench. Nếu bạn đang chọn các checkpoint mô hình trong quá trình phát triển, lọc dữ liệu huấn luyện để kiểm soát chất lượng hoặc gỡ lỗi hành vi mô hình sản xuất ở quy mô lớn, đánh giá Amazon Nova LLM-as-a-judge dựa trên tiêu chí sẽ biến các quyết định ưu tiên không rõ ràng thành những hiểu biết có thể hành động. Bằng cách phơi bày lý do đằng sau mỗi phán đoán, các nhóm có thể xác định các điểm yếu có hệ thống, xác nhận rằng các đánh giá phù hợp với các ưu tiên chất lượng của họ và xây dựng niềm tin lớn hơn vào các pipeline đánh giá tự động.

Để bắt đầu với trọng tài LLM dựa trên tiêu chí của Amazon Nova trên SageMaker AI, hãy tham khảo Rubric Based Judge.

Về tác giả

Surya Kari là Nhà khoa học dữ liệu AI tạo sinh cấp cao tại AWS, chuyên phát triển các giải pháp tận dụng các mô hình nền tảng tiên tiến. Anh có kinh nghiệm sâu rộng trong việc làm việc với các mô hình ngôn ngữ tiên tiến bao gồm DeepSeek-R1, dòng Llama và Qwen, tập trung vào việc fine-tuning và tối ưu hóa chúng cho các ứng dụng khoa học cụ thể. Chuyên môn của anh mở rộng sang việc triển khai các pipeline huấn luyện hiệu quả và chiến lược triển khai bằng cách sử dụng AWS SageMaker, cho phép mở rộng các mô hình nền tảng từ phát triển đến sản xuất. Anh hợp tác với khách hàng để thiết kế và triển khai các giải pháp AI tạo sinh, giúp họ điều hướng lựa chọn mô hình, cách tiếp cận fine-tuning và chiến lược triển khai để đạt được hiệu suất tối ưu cho các trường hợp sử dụng cụ thể của họ.

Joseph Moulton là Kỹ sư phần mềm trong nhóm Tùy chỉnh AGI của Amazon, hỗ trợ triển khai các quy trình đánh giá và suy luận cho AWS Nova Forge. Công việc hiện tại tập trung vào việc phát triển và triển khai các chiến lược mới để khách hàng đánh giá các mô hình Nova được huấn luyện tùy chỉnh của họ. Anh đã làm việc tại công ty với tư cách là kỹ sư phần mềm được 4 năm, gia nhập nhóm nền tảng Machine Learning của Alexa AI vào năm 2022 trước khi chuyển sang nhóm Nova Forge vào năm 2025. Trong thời gian rảnh rỗi, anh thích chơi golf và lắp ráp máy tính.

Morteza Ziyadi là trưởng nhóm khoa học cấp cao và quản lý tại Amazon AGI, nơi anh lãnh đạo một số dự án về các công thức hậu huấn luyện và các mô hình ngôn ngữ lớn (Đa phương thức) trong nhóm mô hình nền tảng Amazon AGI. Trước khi gia nhập Amazon AGI, anh đã dành bốn năm tại Microsoft Cloud and AI, nơi anh lãnh đạo các dự án tập trung vào việc phát triển các mô hình tạo ngôn ngữ tự nhiên thành mã cho các sản phẩm khác nhau. Anh cũng từng là giảng viên phụ trợ tại Đại học Northeastern. Anh lấy bằng Tiến sĩ từ Đại học Nam California (USC) vào năm 2017 và kể từ đó đã tích cực tham gia với tư cách là người tổ chức hội thảo và người đánh giá cho nhiều hội nghị NLP, Computer Vision và Machine Learning.

Rajkumar Pujari là Nhà khoa học ứng dụng II trong nhóm hậu huấn luyện Mô hình Nova tại Amazon AGI. Anh lấy bằng Tiến sĩ Khoa học Máy tính tại Đại học Purdue, chuyên về Machine Learning cho Khoa học Xã hội Tính toán. Hiện tại, công việc của anh tập trung vào hậu huấn luyện và học tăng cường cho các Large Language Models. Anh phát triển các pipeline đánh giá động, quy mô lớn cho các mô hình tiên phong và xây dựng các framework LLM-as-a-Judge.

Swastik Roy là Nhà khoa học ứng dụng cấp cao trong nhóm Nền tảng AGI của Amazon, chuyên về nghiên cứu khả năng tổng quát hóa và hậu huấn luyện các mô hình thuộc dòng Amazon Nova. Chuyên môn của anh bao gồm fine-tuning, học tăng cường và các phương pháp đánh giá, nơi anh thúc đẩy các nỗ lực nhằm nâng cao tính mạnh mẽ của các hệ thống AI nền tảng.

Joel Catapano là Nhà khoa học ứng dụng cấp cao trong nhóm mô hình nền tảng Amazon AGI. Anh chủ yếu làm việc về phát triển các phương pháp tiếp cận mới để cải thiện khả năng LLM-as-a-Judge của các mô hình thuộc dòng Nova.

Mona Mona là Kiến trúc sư giải pháp chuyên gia AI tạo sinh toàn cầu cấp cao, tập trung vào các giải pháp AI tạo sinh trong nhóm Amazon SageMaker AI. Cô từng là chuyên gia AI tạo sinh hàng đầu tại Google trước khi gia nhập Amazon. Cô là tác giả của hai cuốn sách – Xử lý ngôn ngữ tự nhiên với các dịch vụ AWS AI và Hướng dẫn học tập Machine Learning chuyên nghiệp được chứng nhận của Google Cloud. Cô đã viết hơn 20 bài blog về AI/ML và công nghệ đám mây và là đồng tác giả của một bài nghiên cứu về CORD19 Neural Search đã giành giải thưởng Bài nghiên cứu xuất sắc nhất tại hội nghị AAAI (Hiệp hội vì sự tiến bộ của Trí tuệ nhân tạo) danh giá.

Pradeep Natarajan là Nhà khoa học chính cấp cao trong nhóm mô hình nền tảng Amazon AGI, làm việc về các công thức hậu huấn luyện và các mô hình ngôn ngữ lớn đa phương thức. Anh có hơn 20 năm kinh nghiệm trong việc phát triển và ra mắt nhiều hệ thống Machine Learning quy mô lớn. Anh có bằng Tiến sĩ Khoa học Máy tính từ Đại học Nam California.